Acoustic Insulation or Conditioning, What Does My Room Really Need?

When selecting our musical instruments, amplifiers, effects rack, monitors, audio interfaces, etc … we are generally extremely selective. since for some of us, it would be unacceptable to put at risk the quality of our sound. But how is it that many times even having the most ideal equipment we find a not so optimal result? We immediately begin to judge our purchase, or worse even our ears or abilities. When that answer might be in front of us… on the sides and behind, That’s right. The Acoustics of our Room.

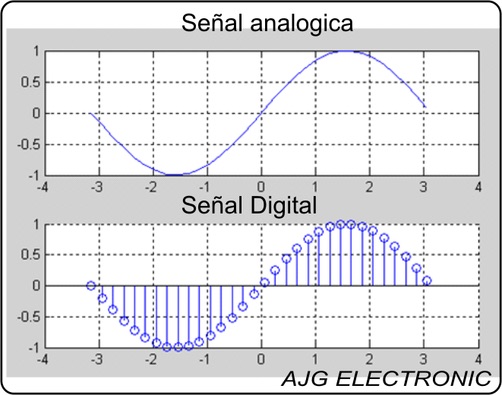

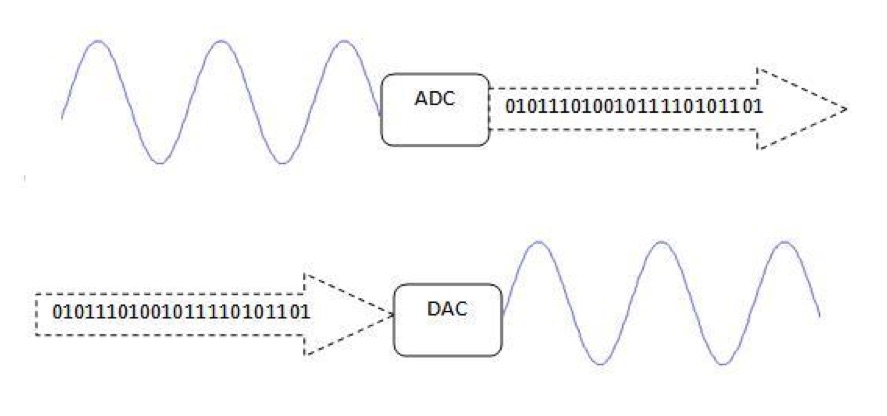

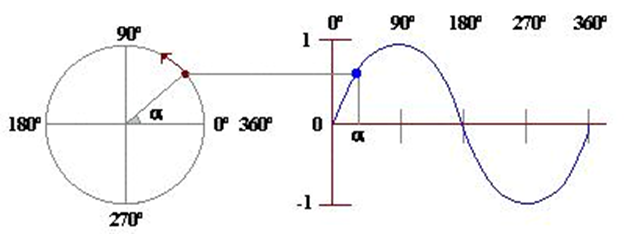

We must remember first that sound is the interpretation that our brain makes through the ears of a set of vibrations (sound waves) propagating in a suitable medium, in our case most common air. And acoustics is the response of those vibrations to a certain sensation. Let’s talk about these sound waves.

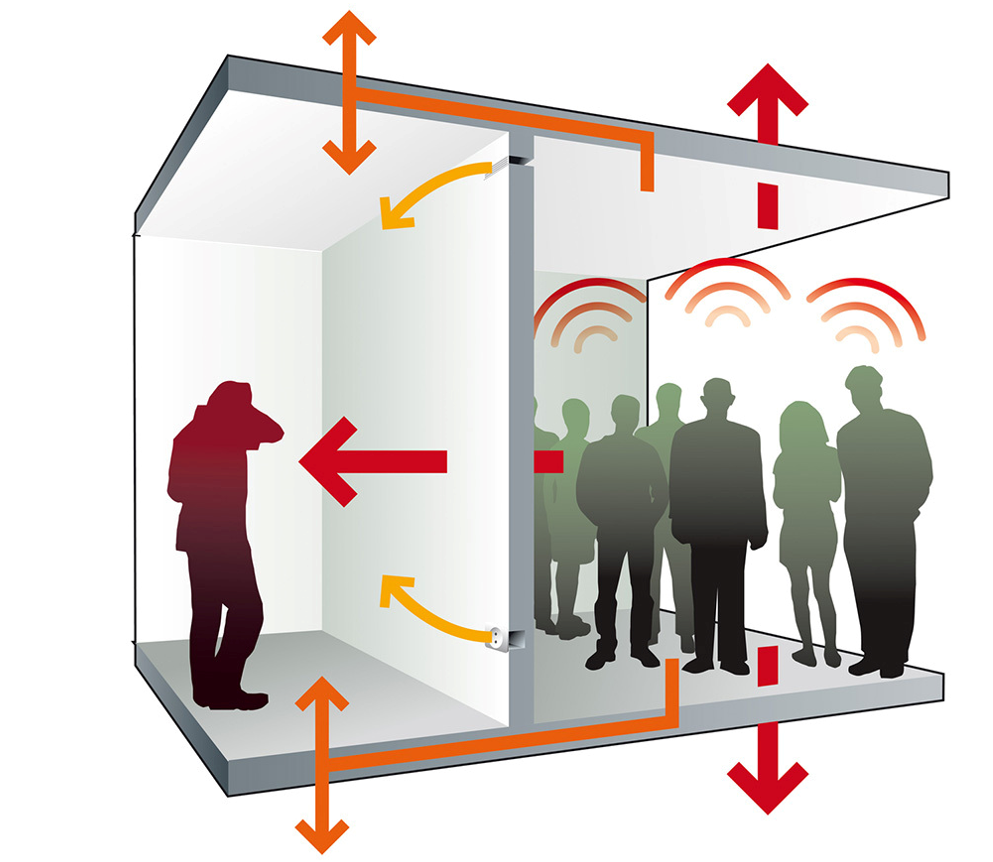

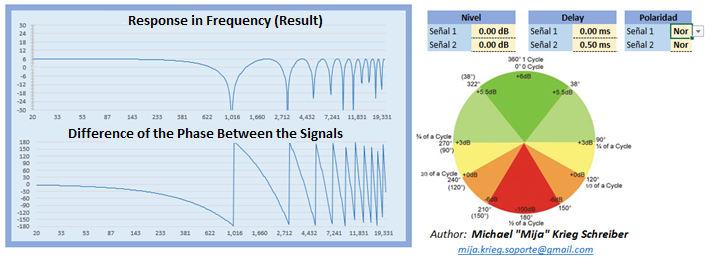

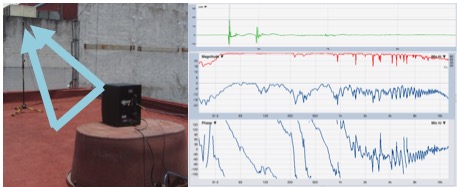

These., are taking a tour of the entire room, before reaching our ears, colliding on all surfaces, and absorbing many elements of the environment. It is for that reason that we always listen with different characteristics, even if it is the same sound source, for example. , the difference we can find when listening to our violin in an auditorium as we would in our room. Or the sound of our voice in a classroom, unlike how it is heard in a bathroom, another example, would be when we hear the same sound source in the same room before and after a move (that is, without the furniture and then with all of them) but, acoustics not only tells us about what happens inside a room but also how the outside can influence our sound source and vice versa. For example. , if our room has a window facing the street, all external sound filtration influences. Similarly, if our case were that the room we are taking as a reference is inside a small house, and our sound source affects the other environments that adjoin it. By paying attention to these details, we can realize that audio as the result depends on many factors. And paying attention to all of them is of the utmost importance so that our final result is the desired one. So, we return to our initial question What do I really need? to give a more concrete answer to this, let’s rather than define the difference between the concepts of insulation and acoustic conditioning. So, let’s see…

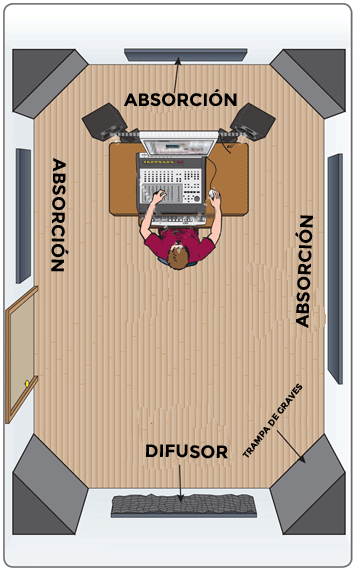

Conditioning Acoustic

When we talk about acoustic conditioning, we refer to everything related to treatments, techniques, tools, or any type of system that allows us to control, improve or modify the interior of the enclosure with which we want to interact, always in order that our sound source to capture or capture is as close to the natural or desired sound.

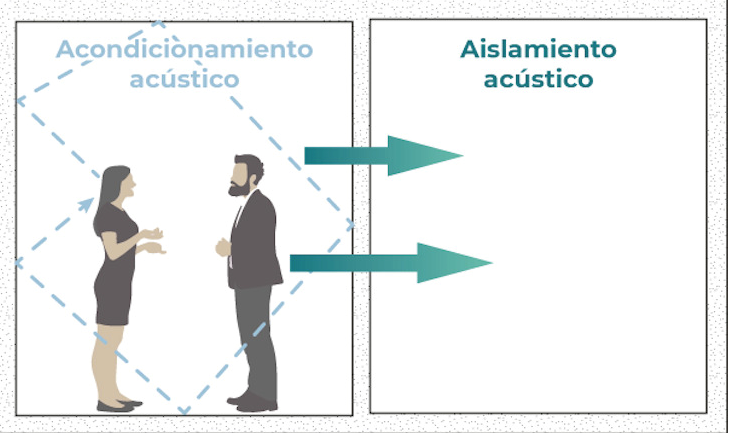

Sound Insulation

This could basically be conceptualized, as controlling what comes out and enters noise/sound to our enclosure. Through materials, treatments, techniques, and any type of system that allows control and/or absorption.

In other words, sound insulation would be the level of sound attenuation that exists between the enclosure and the outside.

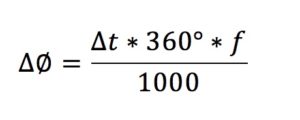

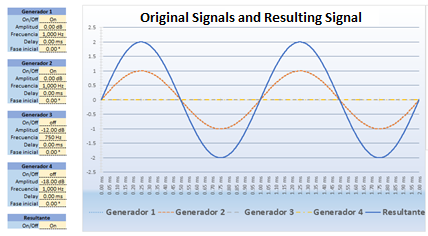

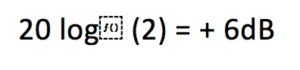

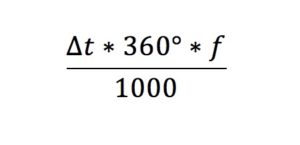

Having these definitions, we approach a clearer way to our response; we can address with greater knowledge the problems that have always surrounded our enclosure. Attacking key points such as, for example, if we talk about acoustic conditioning our objectives would be, to control the reverberation times present in the space, (these may vary, depending on the type of work to be done or the enclosure that we are conditioning, but in general they are short times that seek homogeneity in the frequencies)

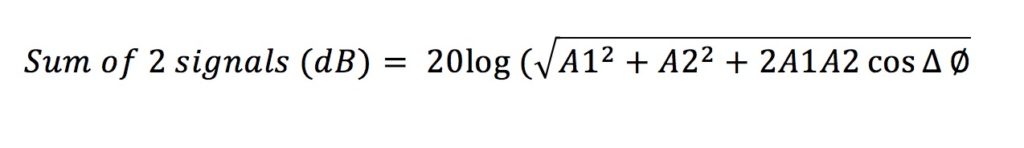

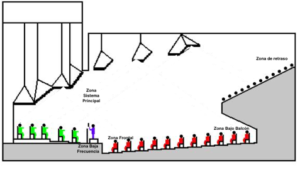

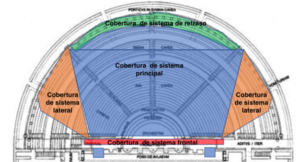

Also, one of our objectives within acoustic conditioning would be to attack these problematic frequencies. The bass frequencies are special, these tend to accentuate the corners of the room. and they generate a really distorted sound image of how the low frequencies are sounding through our monkeys (this is one of those reasons why many times we hear our sound mix so different at home and then when playing it on some device . we can not deceive our ears anymore), it is for this last reason that I would like to mention one more objective within this article, about acoustic conditioning, this one talks about., the diffusion of reverberation. This supports us in such a way that we can hear in a very clear way the direct sound of our monitors and that the reverberation resulting from them does not interfere in a counterproductive way with the rest of the room.

Developing this topic in detail becomes a broad task, and very interesting since within the acoustic conditioning we will find, then. In short, everything that happens within a receptor, speaking of acoustics.

But what if our problem is out of it? That’s where the targets to attack related to sound insulation come in.

This seeks that none of the external sounds interfere with the work that is done inside the enclosure, because let’s say that we are creating a kind of “hermeticism”, likewise we take care that unwanted sounds do not leave our room to the outside.

To achieve this sometimes-structural modifications are needed since they influence many things like, what material are the walls of our enclosure made of, if we have windows, if our windows are sealed or not, the material of our door, etc … to achieve the desired point of isolation.

This is a really challenging mission, but with this, I do not want to say that it is out of our reach, we can try with different treatments and materials if they are and are placed in the right places and go little by little to achieve significant advances.

Now that we have a wider view, we can define in a slightly clearer way what happens in our room, and thus reach a conclusion about What does my room need? This does not mean that both can not be combined, sometimes the output can be a hybrid between both acoustic solutions. The most important thing is to know the difference to know how and in what way to attack the key points and to be able to obtain the most natural, optimal, or desired sound source.

Written By: Maria Fernanda Medina is from Tegucigalpa Honduras. She has a BA in Acoustic Technology and Digital Sound from the Galileo University in Guatemala City. Maria Fernanda has mainly worked in live audio field as a freelancer, and with audio rental companies. Developing herself in the Backline, Stage manager, and Production. Both international concerts and national festivals. “Currently, my passion is for audio and social commitment that I feel with my country, that has guided me in the dissemination and education. I’m enjoying this facet of my life that I get to explore more every day